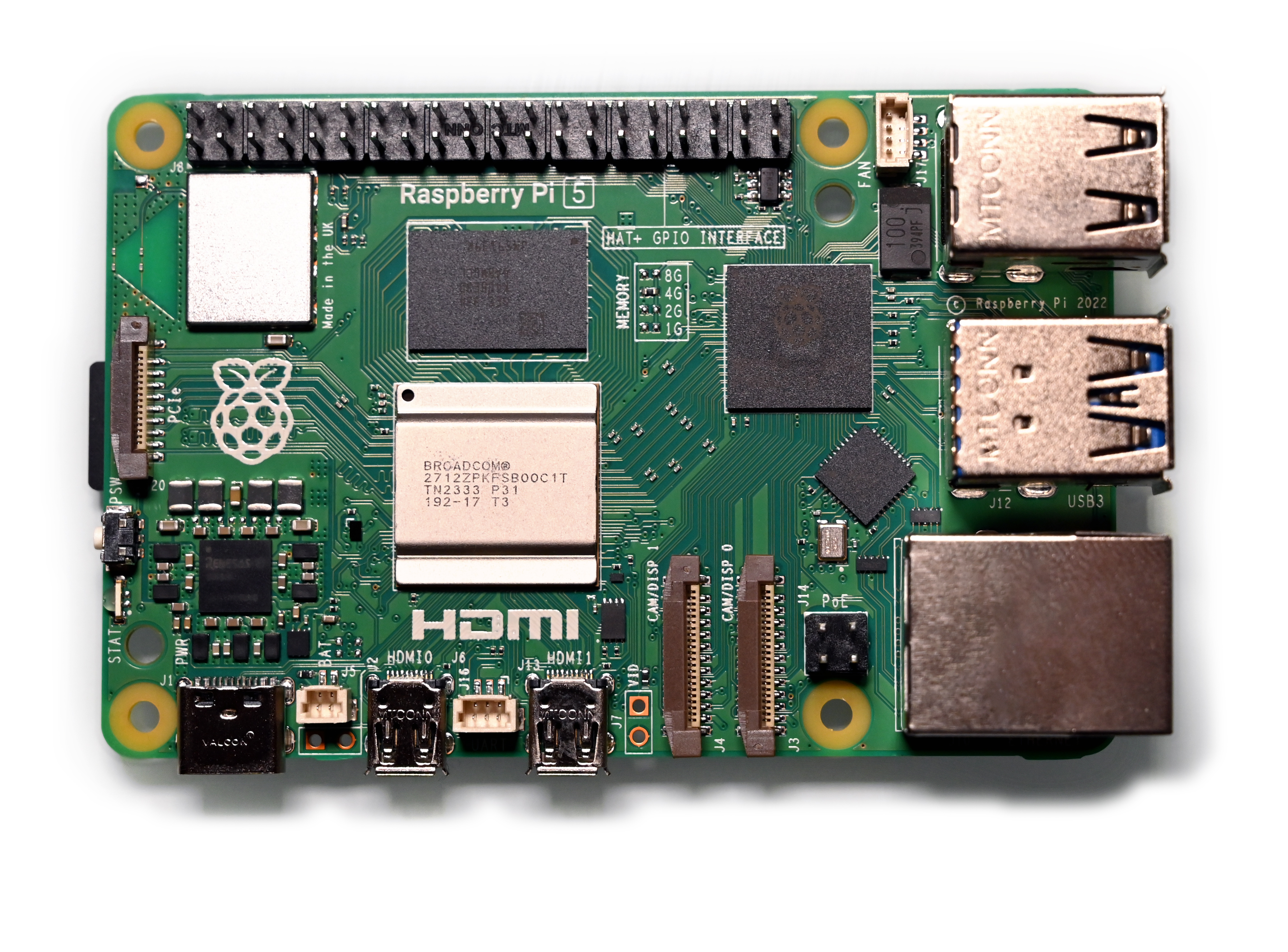

Mit dem Raspberry Pi 5 und Ollama lässt sich ein vollständig lokaler KI-Assistent betreiben – ohne Cloud, ohne Datenweitergabe, ohne laufende Kosten. In diesem Artikel zeige ich euch, wie ihr Ollama auf dem Pi 5 installiert, welche Modelle sich eignen und wie ihr die KI über eine einfache Web-Oberfläche oder API nutzt.

Was ist Ollama?

Ollama ist ein Open-Source-Tool, das es erlaubt, große Sprachmodelle (LLMs) lokal auf eurem eigenen Rechner – oder eben dem Raspberry Pi – zu betreiben. Ihr ladet einfach ein Modell herunter und könnt danach im Terminal oder über eine REST-API chatten. Keine Verbindung zu externen Servern, alles bleibt bei euch.

Voraussetzungen und Hardware

- Raspberry Pi 5 mit 8 GB RAM (~80€) – 8 GB sind Pflicht, 4 GB reichen für kleinere Modelle (1–3B), aber 7B-Modelle laufen nur auf 8 GB flüssig

- NVMe SSD (min. 64 GB) oder microSD A2 – Modelle sind 2–5 GB groß, NVMe deutlich schneller beim Laden

- Aktives Kühlsystem (Offizielles Pi 5 Active Cooler empfohlen) – LLM-Inferenz belastet alle 4 Kerne dauerhaft

- Raspberry Pi OS Bookworm (64-Bit, Lite reicht)

Hinweis zur Performance: Der Pi 5 ist kein High-End-GPU-Server. Erwartet 2–8 Tokens pro Sekunde – das reicht zum Experimentieren, lokalen Codereviews und Heimautomatisierung, aber nicht für produktiven Einsatz mit vielen parallelen Anfragen.

Ollama installieren

Das offizielle Installationsscript erledigt alles automatisch:

|

1 |

curl -fsSL https://ollama.com/install.sh | sh |

Das Script lädt die passende ARM64-Binary, richtet einen systemd-Service ein und startet Ollama sofort. Nach der Installation könnt ihr den Status prüfen:

|

1 |

sudo systemctl status ollama |

Erstes KI-Modell herunterladen und starten

Für den Pi 5 empfehle ich als Einstieg Llama 3.2 (3B) – das Modell ist ~2 GB groß und liefert auf dem Pi 5 akzeptable Antwortgeschwindigkeiten:

|

1 |

ollama run llama3.2 |

Beim ersten Aufruf wird das Modell automatisch heruntergeladen. Danach landet ihr direkt im Chat:

|

1 2 |

>>> Erkläre mir in zwei Sätzen, was ein Raspberry Pi ist. Der Raspberry Pi ist ein günstiger Einplatinencomputer... |

Mit /bye beendet ihr die Chat-Session.

Empfohlene Modelle für den Pi 5

| Modell | Größe | RAM (Pi 5) | Tokens/s (Pi 5 8GB) | Stärken |

|---|---|---|---|---|

| llama3.2:1b | ~1,3 GB | 4 GB | ~8 t/s | Sehr schnell, einfache Fragen |

| llama3.2:3b | ~2,0 GB | 4–8 GB | ~5 t/s | Guter Allrounder, empfohlen |

| mistral:7b | ~4,1 GB | 8 GB | ~2 t/s | Bessere Qualität, langsamer |

| qwen2.5-coder:3b | ~2,0 GB | 4–8 GB | ~5 t/s | Code-Generierung und -Erklärung |

| phi3.5:mini | ~2,2 GB | 4–8 GB | ~4 t/s | Microsoft-Modell, gute Faktentreue |

Alle verfügbaren Modelle findet ihr unter ollama.com/library.

Ollama API verwenden

Ollama stellt eine REST-API auf Port 11434 bereit. So könnt ihr die KI aus eigenen Skripten ansprechen:

|

1 2 3 4 5 |

curl http://localhost:11434/api/generate -d '{ "model": "llama3.2", "prompt": "Was ist der Raspberry Pi 5?", "stream": false }' |

Von einem anderen Gerät im Heimnetz erreichbar machen – in der systemd-Service-Konfiguration die Bind-Adresse ändern:

|

1 |

sudo nano /etc/systemd/system/ollama.service |

In der [Service]-Sektion ergänzen:

|

1 |

Environment="OLLAMA_HOST=0.0.0.0" |

|

1 2 |

sudo systemctl daemon-reload sudo systemctl restart ollama |

Die API ist jetzt unter http://RASPBERRY-PI-IP:11434 erreichbar.

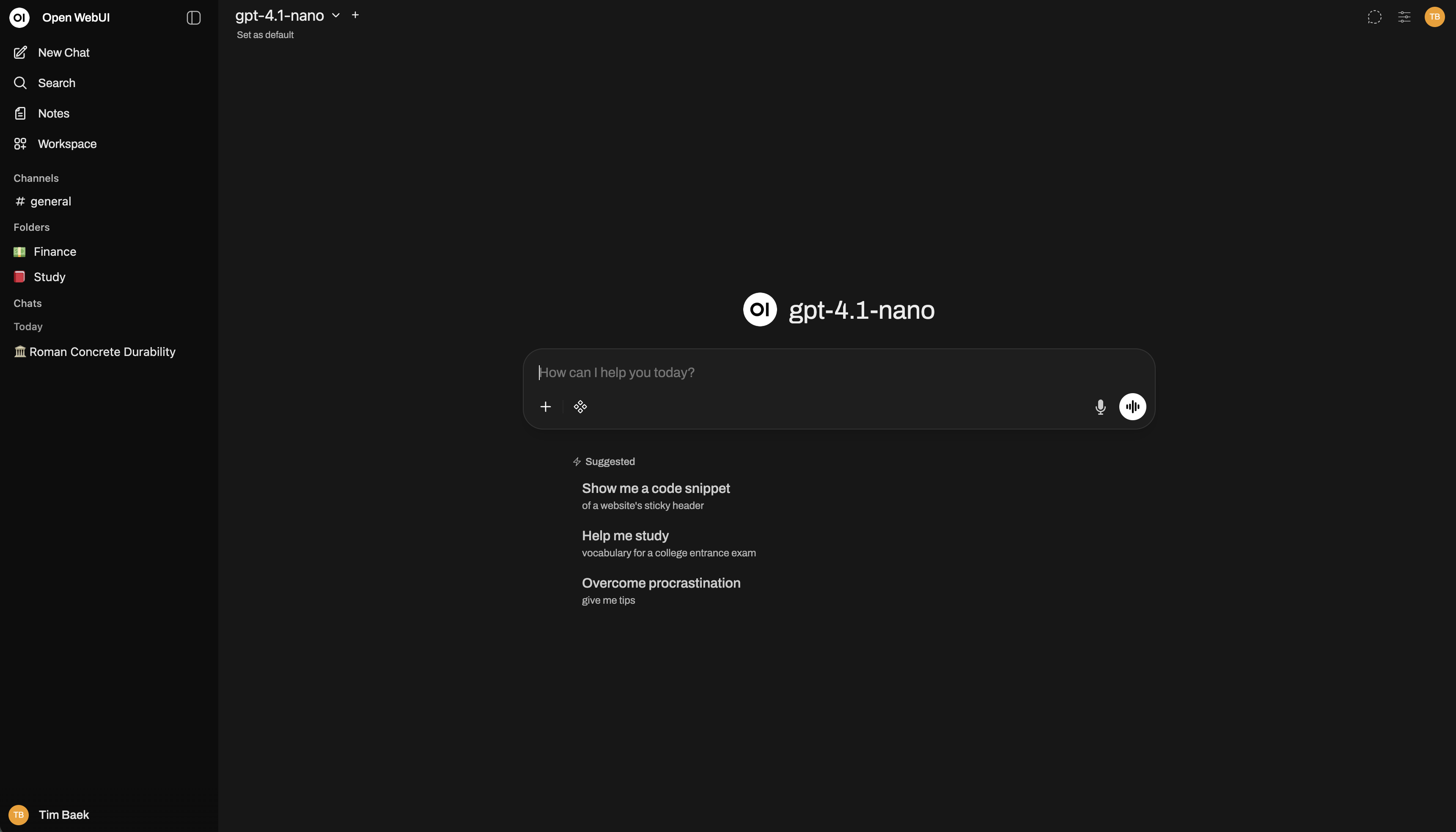

Web-Oberfläche mit Open WebUI

Mit Open WebUI bekommt ihr eine ChatGPT-ähnliche Oberfläche direkt im Browser. Docker ist dafür am einfachsten:

|

1 2 |

sudo apt install docker.io -y sudo usermod -aG docker $USER |

Nach einem neuen Login:

|

1 2 3 4 5 6 7 |

docker run -d \ --name open-webui \ --network=host \ -v open-webui:/app/backend/data \ -e OLLAMA_BASE_URL=http://127.0.0.1:11434 \ --restart always \ ghcr.io/open-webui/open-webui:main |

Die Web-Oberfläche ist danach unter http://RASPBERRY-PI-IP:3000 erreichbar.

Mehrere Modelle verwalten

Installierte Modelle anzeigen:

|

1 |

ollama list |

Modell entfernen (gibt Speicher frei):

|

1 |

ollama rm mistral:7b |

Modell aktualisieren:

|

1 |

ollama pull llama3.2 |

Performance-Tipps für den Pi 5

Temperatur im Auge behalten: Während der LLM-Inferenz kann der Pi 5 auf 80°C klettern. Mit dem Active Cooler bleibt er unter 70°C:

|

1 |

watch -n 2 vcgencmd measure_temp |

NVMe statt microSD: Modelle auf einer NVMe-SSD laden 3–5× schneller als von einer microSD. Die Ladezeit für llama3.2:3b sinkt von ~15s auf ~4s.

Swap deaktivieren oder erhöhen: Bei 8 GB RAM und 7B-Modellen kommt der Pi ans Limit. Swap auf NVMe erhöhen statt auf microSD:

|

1 2 3 4 5 |

sudo dphys-swapfile swapoff sudo nano /etc/dphys-swapfile # CONF_SWAPSIZE=2048 sudo dphys-swapfile setup sudo dphys-swapfile swapon |

Modell im Speicher halten: Damit das Modell nach dem ersten Laden nicht wieder entladen wird:

|

1 |

ollama run llama3.2 --keepalive -1 |

Anwendungsbeispiele

- Heimautomatisierung: Node-RED oder Home Assistant sendet Sensordaten an die Ollama-API und bekommt eine Zusammenfassung oder Handlungsempfehlung

- Lokaler Code-Assistent: VS Code mit der Ollama-Extension oder Continue.dev verbinden

- Offline-Sprachassistent: Whisper (Spracherkennung) + Ollama + Piper (TTS) für einen vollständig lokalen Assistenten ohne Cloud

- Dokumenten-Zusammenfassung: PDFs oder Texte per Skript an die API schicken und zusammenfassen lassen